رادیوی اسرارآمیز؛ ایستگاهی که معلوم نیست گردانندهاش کیست. و کانادا ,صداهای اسرارآمیز قطب شمال .

رادیوی اسرارآمیز؛ ایستگاهی که معلوم نیست گردانندهاش کیست

در نزدیکی شهر سنپترزبورگ روسیه، درست وسط یک زمین باتلاقی دروازه آهنی مستطیل شکلی دیده میشود. پشت ستونهای زنگ زده این دروازه، مجموعهای از چندین برج رادیویی، ساختمانهای متروک و دکلهای برقی قرار دارند که با دیواری سنگی احاطه شدهاند. در دل این مکان ترسناک رازی از دوران جنگ سرد نهفته است.

گفته میشود این مکان مرکز اصلی یک ایستگاه رادیویی به نام "MDZhB" است که معلوم نیست چه کسی آن را میگرداند. در سه دهه و نیم گذشته هفت روز در هفته و ۲۴ ساعت در روز صدایی یکنواخت و نامشخص شبیه "وز وز" از این ایستگاه رادیویی پخش میشود. هر چند ثانیه یک بار هم صدای دیگری به گوش میرسد؛ صدایی شبیه بوق "کشتی ارواح" در شبی مهآلود.

ر در هفته هم، صدایی که معلوم نیست متعلق به یک مرد است یا زن، چند کلمه به روسی ادا میکند؛ کلمههایی مثل "قایق بادی" یا "متخصص کشاورزی". این کل چیزی است که از این ایستگاه رادیویی پخش میشود. هر کس هر کجای دنیا که باشد با تنظیم موج رادیو روی فرکانس ۴۶۲۵ کیلوهرتز میتواند این صداها را بشنود.همه چیز فوقالعاده اسرارآمیز به نظر میرسد، انگار پشت طراحی و راهاندازی این ایستگاه رادیویی نقشه مخفیانهای در کار است. این ایستگاه رادیویی که در بین طرفدارانش با نام "وزوزکن" (The Buzzer ) شناخته میشود در حال حاضر بیش از دهها هزار نفر در شبکههای اجتماعی هوادارش هستند. دو ایستگاه رادیویی مشابه دیگر هم در روسیه وجود دارد که هوادارانشان نامهای "The Pip" (بیب) و "Squeaky Wheels" (لاستیک جیرجیری)را به آنها دادهاند. هوادارانی که میگویند، اصلا نمیدانند چرا به این صداها گوش میدهند.

در واقع هیچکس دلیلش را نمیداند. دیوید استاپلز، متخصص شنود الکترونیک و استاد دانشگاه سیتی لندن در این باره میگوید: "این سیگنالها عملا هیچ اطلاعاتی در خودشان ندارند."

پخش این فایل در دستگاه شما پشتیبانی نمی شود.

Enable it in your browser or فلش پلیر را از اینجا دانلود کنید.

برای پخش این فایل به برنامه فلش نیاز دارید.

بخشی از صداهایی که در ژوئیه سال گذشته از رادیوی اسرارآمیز پخش شد. برخی میگویند وقتی صدای وزوز این شبکه رادیویی قطع شود، موشکهای قارهپیمای روسیه به طور خودکار پرتاب خواهند شد.

چه اتفاقی میافتد؟

گفته میشود که این ایستگاه رادیویی به ارتش روسیه تعلق دارد، هر چند که آنها هیچوقت چنین چیزی را تأیید نکردهاند. این ایستگاه در پایان جنگ سرد شروع به کار کرد، زمانی که کمونیسم رو به افول بود. امروزه امواج آن از دو مرکز، یکی نزدیک به سنپترزبورگ و دیگری نزدیک مسکو فرستاده میشوند. بعد از فروپاشی شوروی سابق، به عکس پیشبینیها فعالیت این ایستگاه نه تنها متوقف نشد بلکه بیشتر هم شد.

نظریههایی که در مورد دلیل فعالیت این ایستگاه رادیویی مطرح شده، کم نیستند؛ از مخابره اطلاعات با زیردریاییها گرفته تا ارتباط با موجودات فضایی. برخی هم آن را با سیستم "دست مرده" (Dead Hand) که شوروی سابق در دوره جنگ سرد راهاندازی کرد مرتبط میدانند و معتقدند در صورت حمله اتمی، صدای وزوز این شبکه رادیویی قطع میشود و موشکهای قارهپیمای روسیه به طور خودکار پرتاب خواهند شد؛ به بیان دیگر ویرانی کامل دو طرف درگیر در جنگ.

این ایده البته خیلی هم بی منطق به نظر نمیرسد. سیستم دست مرده یک سیستم کامپیوتری بود که از طریق بررسی امواج رادیویی، تشعشعات رادیواکتیو را تشخیص میداد. سیستمی که به اعتقاد برخی از کارشناسان هنوز هم فعال است. ولادیمیر پوتین، رئیس جمهوری روسیه همین چند وقت پیش گفت هیچ کس از جنگ هستهای بین روسیه و آمریکا جان سالم به در نخواهد برد. آیا "وزوزکن" میتواند جلوی چنین جنگی را بگیرد؟

نکته مهم در مورد این ایستگاه رادیویی این است که مثل همه رادیوهای بینالمللی روی موج کوتاه کار میکند. تفاوت آنها و امواج با بسامد بالا در این است که فقط در خط مستقیم حرکت نمیکنند تا در اثر برخورد با موانع از بین بروند. امواج کوتاه بعد از برخورد به ذرات باردار در جو زمین از آنها دور میشوند.

این ویژگی به آنها اجازه حرکت زیگزاگی بین زمین و آسمان را میدهد. به این معنا که سیگنالهایی که این ایستگاه میفرستد در مقایسه با سیگنالهای رادیوهای محلی، تلفنهای همراه و تلویزیون مناطق وسیعتری را پوشش خواهند داد و میتوانند دهها هزار کیلومتر را طی کنند.

به همین دلیل هم کشتیها، هواپیماها و ارتش برای فرستادن پیامهایشان به آن سوی قاره، اقیانوس و کوهستان از امواج کوتاه استفاده میکنند. نکتهای که باز ذهن را به سمت تئوری دست مرده سوق میدهد.

البته از یک نکته نباید غافل شد. سرعت حرکت امواج کوتاه در روز و شب یکسان نیست و اگر میخواهید همه در تمام ساعات شبانهروز و هر نقطه از دنیا به ایستگاه رادیوییتان دسترسی داشته باشند، به ویژه اگر از آن به عنوان علامت شروع جنگ اتمی که احتمالا قصد راه انداختنش را دارید، استفاده میکنید باید فرکانس امواج را بسته به ساعت شبانه روز تغییر دهید. این کاریاست که رادیوی بخش جهانی بیبیسی انجام میدهد اما "وزوزکن" نه.

نکته دیگری که به گفته استاپلز باید به آن توجه کرد این است که این ایستگاههای رادیویی برای اندازهگیری فاصله لایه ذرات باردار جو راهاندازی شده. او میگوید: "اگر میخواهید از سیستم راداری که روسها برای ردیابی موشکها استفاده میکنند بهترین نتیجه را بگیرید، باید این نکته را بدانید." هر چقدر مدت زمان بالا رفتن و پائین آمدن سیگنال در هوا بیشتر باشد، سیگنال در ارتفاع بلندتری حرکت میکند.

به عقیده استاپل البته این ایستگاه رادیویی نمیتواند برای این منظور راه افتاده باشد. سیگنالی که برای بررسی ارتفاع لایه ذرات باردار جو فرستاده میشود معمولا یک صدای مشخص شبیه به صدای خاموش شدن تدریجی آژیر ماشین تولید میکند که در واقع نتیجه تغییر موجها برای رسیدن به فرکانس درست است. استاپلز میگوید:" این صدا هیچ شباهتی با صدای بوقی که از این ایستگاه رادیویی میشنویم، ندارد."

یک ایستگاه رادیویی که به شکلی باورنکردنی به "وزوزکن" شبیه بود و در جای دیگری از دنیا وجود داشت: "لینکلن شایر پوچر" ( نام یک آواز محلی انگلیسی) که از اواسط دهه ۱۹۷۰ تا سال ۲۰۰۸ کار میکرد. صدای این ایستگاه رادیویی در آن سوی دنیا هم شنیده میشد، اما کسی از محل آن خبر نداشت؛ درست مثل " وزوزکن".

گفته میشد مقر این ایستگاه در قبرس است. از آن هم صداهای عجیب و وحشناکی شنیده میشد. در ابتدای هر ساعت چند خط اول ملودی آواز لینکلنشایر پوچر، ۱۲ بار پشت سر هم پخش و بعد از آن صدای ضبط شده زنی شنیده میشد که با لهجهای شبیه به اشرافیان انگلیسی ۵ عدد یک، دو، صفر، سه و شش را ادا میکرد.

برای درک ارتباط این دو ایستگاه بهتر است به دهه ۱۹۲۰ برگردیم. شرکت تعاونی "آل راشن" - آنطور که خودشان ادعا میکردند- یک شرکت بازرگانی بسیار مهم به حساب میآمد که روی معاملات بریتانیا و شوری سابق نظارت میکرد.

در سال ۱۹۲۷، پلیس به ساختمان این تعاونی حمله کرد و مشخص شد زیرزمین آن به سیستم حفاظتی مجهز بوده. آنها همچنین یک اتاق مخفی در این زیرزمین پیدا کردند که درش دستگیره نداشت و کارگران در آن در حال سوزاندن مدارک بودند. در این حمله انگلیسیها چیزی جز آنچه خودشان از قبل میدانستند کشف نکردند. اما روسها تازه فهمیدند "ام آی فایو" ( اداره امنیت داخلی بریتانیا) سالها آنها را شنود میکردهاست.

در نتیجه این اتفاق، روسها روش رمزگذاری پیامهایشان را تغییر دادند، آن هم در یک شب. آنها سیستم "پد یکبارمصرف" را به کار انداختند. در این روش فرستنده پیام، یک کلید رمزگذاری را به طور تصادفی انتخاب میکند و آن را فقط با گیرنده به اشتراک میگذارد. اگر این کلید کاملا به شکل تصادفی انتخاب شود احتمال رمزگشایی پیام به صفر میرسد. به این ترتیب روسها دیگر نگران لو رفتن پیامهایشان نبودند.

و اینگونه بود که "ایستگاههای اعداد" به وجود آمدند؛ ایستگاههای رادیوی موج کوتاه که برای جاسوسها در سراسر دنیا پیام میفرستادند. مأموران انگلیسی اما بیکار ننشستند و آنها هم به این روش روی آوردند. انتخاب کلید رمزگذاری تصادفی و غیرتکراری البته کار آسانی نبود. ولی انگلیسیها برایش راهی پیدا کردند. آنها یک میکروفون را از پنجره دفترشان در خیابان "آکسفورد" لندن آویزان میکردند تا صدای ترافیک را ضبط کند. استاپلز میگوید:" ممکن بود صدای بوق یک اتوبوس همزمان با پلیسی که فریاد میکشد ضبط شود. این صدا کاملا خاص است چون این اتفاق دوباره نخواهد افتاد." آنها این صدا را به یک رمز تصادفی تبدیل میکردند.

این شبکه ارتباطی جدید بسیار مفید بود و طولی نکشید که ایستگاههای اعداد همه دنیا را گرفتند. هفت سال پیش بود که خبر انهدام شبکهای از جاسوسان روس توسط "افبیآی" منتشر شد. گفته میشد آنها دستورات را از طریق پیامهای رمزگذاریشده که ایستگاه رادیویی موج کوتاه با فرکانس ۷۸۸۷ کیلوهرتز میفرستاد، دریافت میکردند.

حالا کره شمالی هم به استفاده از این ایستگاه های رادیویی روی آورده است. روز ۱۴ آوریل ۲۰۱۷، این پیام از رادیو پیونگ یانگ پخش شد: "من درس فناوری اطلاعات مقدماتی دانشگاه آموزش از راه دور را برای گروه ماموران اعزامی شماره ۲۷ دوره می کنم." در ادامه این پیغام - که به وضوع یک پیام نظامی است - یک سری عدد و شماره صفحه مثل شماره ۶۹ در صفحه ۸۲۳ و صفحه ۹۵۷ شنیده می شد، اعداد و ارقامی که شباهت زیادی به کد دارند.

جالب اینجاست که این ایستگاههای اعداد هنوز فعال هستند با این مزیت که امروزه هر کس در هر جای دنیا میتواند پیام های این ایستگاه ها را بشنود، بدون آنکه بداند برای چه کسی فرستاده میشوند. البته امکان تشخیص منبع فرستنده امواج وجود دارد. تلفن های همراه و اینترنت شاید سریعتر باشند اما احتمال لو رفتن به محض باز کردن پیام یا ایمیل دریافتی از یک آژانس اطلاعاتی وجود دارد.

بنابراین شاید این ایده که "وزوزکن" یکی از این ایستگاههاست و سالها بدون جلب توجه برای جاسوسان روس در سراسر دنیا پیام میفرستاده، ایده وسوسهانگیزی باشد. اما یک مشکل وجود دارد. این ایستگاه هیچوقت پیامهایی به شکل اعداد پخش نمیکند.

این مسأله البته اهمیت چندانی ندارد چون پدهای یکبارمصرف قابلیت ترجمه هر چیزی را دارند، از کلمات رمزی گرفته تا صحبتهای نامفهوم. استاپلز میگوید:" اگر یک تماس تلفنی رمزگذاری شود شما احتمالا به جای پیام اصواتی نامفهوم میشنوید اما کسی که پیام برایش فرستاده میشود، آن را به شکل طبیعی دریافت میکند."

وقتی از طریق رادیو پیامی میفرستیم، ارتفاع یا فاصله امواج ارسالی را تغییر میدهیم. مثلا دو موج کوتاه پشت سر هم به معنای "X" است یا سه موج نزدیک به هم معنی "y" میدهد. وقتی یک سیگنال اطلاعاتی را حمل میکند به جای امواج منظم و با فواصل یکنواخت مثل ریزموجهای اقیانوس، با امواجی شبیه به خطوط دندانهدار نوار قلبی روبرو هستیم.

این تحلیل اما به نظر نمیرسد در مورد "وزوزکن" صدق میکند. خیلیها به عکس معتقدند که این ایستگاه رادیویی آمیزهای از دو چیز است. صدای وز وز ممتد یک علامت است که در واقع میگوید" این فرکانس مال من است، این فرکانس مال من است ..." تا از این طریق به دیگران بفهماند حق استفاده از آن را ندارند. به عقیده این دسته، وزوز کن فقط در مواقع بحران به یک ایستگاه اعداد تبدیل میشود. مثلا اگر به روسیه حمله شود از آن برای فرستادن پیام به شبکه جاسوسی و نیروهای ارتش که در مناطق دوردست در حال آماده باش هستند، استفاده میشود. روسیه البته کشوری است با مساحتی ۷۰ برابر انگلستان.

این طور که پیداست گردانندگان این ایستگاه تمرین در این زمینه را شروع کردهاند. ماریس گولدمینز، اهل کشورهای بالتیک و یکی از علاقمندان این ایستگاه رادیویی میگوید: " در سال ۲۰۱۳ یک پیام ویژه پخش کردند: فرمان ۱۳۵ صادر شد. گفته میشد این پیامی آزمایشی برای آمادگی کامل رزمی بود."

رمز و راز این ایستگاه رادیویی روسی شاید حل شده به نظر بیاید. اما اگر حق با هوادارانش باشد، باید امیدوار باشیم صدای وزوز هیچوقت قطع نشود

کانادا هنوز توضیحی برای صداهای اسرارآمیز قطب شمال ندارد

مقامهای رسمی کانادا به بیبیسی گفتهاند که در حال تحقیق در مورد صداهای اسرارآمیزی هستند که از کف دریا در مناطق دوردست قطب شمال به گوش میرسد.

این صدای عجیب و غریب طی ماههای گذشته بارها توسط ساکنان محلی گزارش شده و باعث هراس حیوانات شده است.

مقامهای کانادایی گفتهاند روز جمعه با استفاده از یک هواپیمای نظامی تجسسی از این منطقه بازرسی کردند اما ارتش کانادا هنوز نمیتواند در مورد دلیل این "صدای غیر متعارف" توضیحی دهد.

ارتش کانادا در بیانیهای که در اختیار بیبیسی قرار داد گفت در عملیات تجسسی خود، موفق به ردیابی و کشف هیچ تماس سطحی یا زیرسطحی نشده است.

این بیانیه میگوید تنها چیزی که خدمه این هواپیما در آن منطقه مشاهده کردند، گروهی نهنگ و گراز دریایی بوده است..

سخنگوی وزارت دفاع ملی در اتاوا گفته است دلیل این صدا که ساکنان محلی از طریق بدنه کشتیها هم میتوانند بشنوند، یک معما است.

این صدا که شماری آن را شبیه زمزمه یا صدای تند و تیز خواندهاند در طول تابستان امسال در تنگه فوری و هکلا در ۱۲۰ کیلومتری شمال غربی ایگلولیک به گوش ساکنان رسیده است.

این ناحیه دور افتاده، کمجمعیتترین منطقه کانادا است و در نزدیکی گرینلند قرار دارد.

نیمی از ما تا سی سال دیگر 'بیکار خواهیم بود'

نیمی از ما تا سی سال دیگر 'بیکار خواهیم بود'

حق نشر عکس Thinkstock

حق نشر عکس Thinkstock دانشمندان پیش بینی می کنند نیمی از جمعیت بشر تا سی سال دیگر بیکار خواهند شد چرا که ماشین و روبات جای آنها را خواهند گرفت.

موشه واردی، متخصص علوم کامپیوتر و استاد دانشگاه رایس، می گوید: "بشریت در آستانه شاید بزرگترین چالش تاریخ است، یافتن معنای زندگی، وقتی که عرق جبین و کد یمین برای گذران زندگی دیگر معنا ندارد."

پروفسور واردی که در نشست سالانه انجمن پیشرفت های علمی آمریکا سخنرانی می کرد، گفت: "ما داریم به زمانی می رسیم که ماشینها در بسیاری از کارها از انسان بهتر خواهند بود... من فکر می کنم جامعه باید پیش از اینکه این سوال پیش رویش قرار گیرد به آن پاسخ دهد."

به گفته پروفسور واردی ساخت هوش مصنوعی شتاب گرفته و همزمان نیروی کار "یقه سفید"، طبقه متوسط متخصص، رو به اضمحلال می رود و این زمینه ساز افزایش نابرابری درآمدی است.

سال گذشته اندی هالدین، اقتصاددان ارشد بانک انگلستان، تخمین زد که روبات ها نیمی از مشاغل بریتانیا، پانزده میلیون شغل را در خطر قرار داده و "سومین عصر ماشین" شکاف غنی و فقیر را در دنیا عمیق تر خواهد کرد.

بررسی بانک انگلستان نشان می دهد کارهای اداری، تولیدی و دفتری و مشاغل کم در آمد بیشتر در معرض خطر قرار دارند اما مشاغل با درآمد متوسط نیز با شتابی روزافزون در معرض اتوماسیون (خودکارسازی) هستند.

در بسیاری از نقاط دنیا حرکت به سمت جایگرینی انسان با روبات آغاز شده است، صنایع هر چه بیشتر به سمت روباتها می روند، مثل صنایع الکترونیک و شرکت هایی مثل فاکس کان، سامسونگ یا صنایع هواپیماسازی.

ایرباس اعلام کرده قصد دارد دیگر کارهای "خطرناک و دشوار" را به انسان نسپرد تا کارکنانش بتوانند بر کارهای "باارزش تر" تمرکز کنند.

یک ماه و نیم پیش، در دانشگاه تکنولوژی نانیانگ در سنگاپور، روباتی به عنوان مسئول پذیرش مشغول کار شد.

نادین، که او را نزدیکترین روبات به انسان می دانند، با پوست نرم و موهای قهوه ای صاف، نه تنها به مراجعان با لبخند خوشامد می گوید و با آنها دست می دهد، بلکه مراجعان گذشته را به یاد می آورد و بر اساس گفتگوهای قبلی می تواند سر صحبت را با آنها باز کند.

نادین بر خلاف روباتهایی که تا به حال ساخته شده اند، شخصیت، خلق و خو و احساسات خاص خود را دارد و بر حسب شرایط یا موضوع می تواند شاد یا غمگین باشد.

نگرانی از حضور گسترده هوش مصنوعی در زندگی بشر حتی به سازمان ملل هم رسیده است، پارسال نمایندگان گروهی به نام "جلوی روبات قاتل را بگیرید" در این زمینه با دیپلماتهای سازمان ملل ملاقات کردند.

اما مسئله فقط این نیست که روباتها به زودی از نردبان بالا می روند یا به فضاهای کوچک و تنگ می خزند و تا ده سال دیگر جای نیروی کار انسان را می گیرند آنها حتی قرار است نقش همدم یا شریک جنسی ما را هم بازی کنند.

این چالشی جدید است. پروفسور واردی می گوید وضعیت موجود را نباید با انقلاب صنعتی مقایسه کرد، در آن زمان ماشین های پر قدرت جای نیروی جسمی و کاری بشر را گرفتند اما اکنون فقط نیروی بدنی بشر نیست که در معرض تهدید است، هوش و مهارت های شناختی او نیز در رقابت با هوش مصنوعی روز بروز بیشتر میدان را واگذار می کند.

پروفسور واردی یادآوری می کند که در آن زمان پنجاه درصد بیکاری در اقتصاد جهانی پیامدهای جدی اجتماعی خواهد داشت و آمریکا را مثال می زند که چگونه پیشرفت فناوری، آن را در پنجاه سال گذشته عمیقا متحول کرده است:

"ما از شنیدن اینکه بیکاری این ماه ۴.۸ درصد کاهش یافته خوشحال می شویم، اما توجه به گزارش های ماهانه اشتغال این واقعیت را مخفی می کند که آمریکا در ۳۵ سال گذشته در بحران اقتصادی بوده است."

پروفسور واردی با اشاره به تحقیقی که در MIT انجام شده گفت آمریکایی ها با پرکاری تولید ناخالص ملی را همچنان به پیش می برند اما حداکثر اشتغال حول و حوش ۱۹۸۰ اتفاق افتاد و [از آن زمان به بعد] متوسط درآمد خانواده ها کاهش یافته است. این اثر اتوماسیون است."

حال سوال این است که اگر بیشتر کارهای انسان را قرار است ماشین ها و روبوت ها انجام دهند، انسانها باید چکار کنند؟ استراحت و تفریح؟

پروفسور واردی در باره اینکه این تحول به نفع بشریت خواهد بود تردید دارد:

"معمولا جواب این است که اگر ماشین تمام کارهای ما را انجام بدهد، ما فرصت خواهیم داشت دنبال تفریح برویم...من این آینده را روشن نمی بینم. چشم انداز زندگی صرفا تفریح را جذاب نمی دانم. این از نظر من مدینه فاسده است. من کار کردن را برای سعادت بشر ضروری می دانم."

آیا میتوان به روباتها اخلاق آموخت؟

آیا میتوان به روباتها اخلاق آموخت؟

اغلب ما فکر میکنیم که عصر روباتها موضوع داستانها علمی-تخیلی است و بحث اخلاق روباتی موضوعی مربوط به آینده دور، اما زمانی که واقعا با این مسائل روبرو باشیم بسرعت فرا میرسد؛ زمانی که تصمیمها را روباتها میگیرند. سوال این است که روباتها باید این تصمیمها را بر مبنای اخلاقیات بگیرند و اینکه آیا میتوانیم اخلاق را به روباتها آموزش دهیم؟

ماشین طبق برنامه سر ساعت هشت صبح جلوی در خانه میرسد تا شما را به سر کار ببرد. شما سوار میشوید و در صندلی عقب مینشینید و ابزار الکترونیک خود را از کیف درمیآورید تا نگاهی به اخبار بیندازید. تا به حال مشکلی در مسیر خانه تا محل کار پیش نیامده و معمولا ترافیک سبک است. اما امروز اتفاقی غیرعادی و وحشتناک میافتد، دو بچه که با هم گلاویز شدهاند درست جلوی ماشین شما ناگهان وارد خیابان میشوند. فرصت ترمز کردن نیست یا باید با دو بچه بزنید یا بسرعت فرمان را به راست بچرخانید تا از کنار آنها رد شوید اما در این صورت به دوچرخهای که از روبرو میآید برخورد میکنید.

هر دو احتمال بد هستند، اما کدام کمتر بد است؟

پیش از جواب دادن به این سوال یک چیز دیگر را باید بدانید، سال ۲۰۲۷ است و ماشین شما بدون راننده و خودکار است.

در ماشین کنار دکتر ایمی ریمر نشستهام و او پشت فرمان است.

ایمی دکمهای را روی صفحهای فشار می دهد و بدون اینکه به هیچ چیز دیگر دست بزند، ماشین به نرمی راه میافتد، راهنما میزند، پشت چراغ قرمز میایستد، یک پیچ تند را رد میکند، دور میدان میگردد و بعد به آرامی در کناری پارک میکند.

پنج دقیقه اول شدیدا نگران کننده است، اما بعد یکنواخت و کسالتبار میشود. ایمی که دانشجوی دکترا در دانشگاه کمبریج است، سرمهندس خودروهای خودکار جگوار لندرور است. او مسئول این است که این خودرو چه چیزهایی را ببنید و چه واکنشی به آن نشان دهد.

ایمی معتقد است که این ماشین یا ماشینی مشابه آن تا ده سال دیگر در خیابانها تردد خواهند کرد. البته باید مشکلات فنی زیادی مرتفع شوند، اما یک مشکل هست که حتی ممکن است حضور این خودروها را در خیابانها به تعویق بیندازد، مشکلی که نه الکترونیکی است نه مکانیکی: مسئله اخلاق.

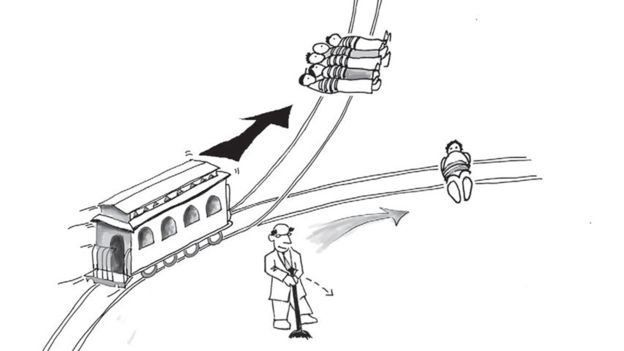

مسئلهای که در مثل دو کودک مطرح شد یکی از اشکال مسئله معروف به "مسئله قطار" در فلسفه است. ترمز یک قطار (یا تراموای) در حال حرکت میبرد. فاجعهای در پیش است چون پنج نفر به ریلهای قطار بسته شدهاند. اگر کاری نکنید همگی میمیرند. کاری که میتوانید بکنید این است که ریل عوض کنید و جان پنج نفر را نجات دهید. مسئله اینجا است که در مسیر جدید هم یک نفر روی ریل است. چه باید بکنید؟ هیچ کاری نکنید و بگذارید پنج نفر کشته شوند یا ریل عوض کنید و یک نفر کشته شود، کار درست چیست؟

این سوال از میلیونها نفر در سراسر دنیا پرسیده شده، بیشتر افراد میگویند باید قطار تغییر مسیر دهد.

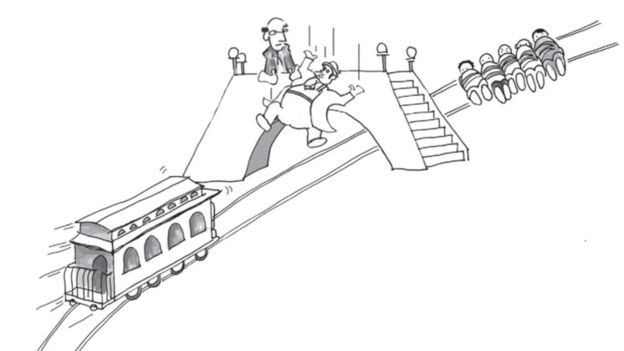

حالا شکل دیگر این مسئله را در نظر بگیرید. همان قطار ترمز بریده به سمت آن پنج نفر در حال حرکت است. شما بالای پلی ایستاده ید که قطار قبل از اینکه به آن پنج نفر برخورد کند باید از زیر آن رد شود. روی پل یک نفر هم با کولهپشتی عظیم خود ایستاده است. تنها راه نجات آن پنج نفر این است که مرد را با کوله پشتی بزرگش از بالای پل، روی ریل بیندازید تا باعث توقف قطار شود. دوباره مسئله بین جان پنج نفر و جان یک نفر است. اما در این مورد بیشتر مردم پاسخ میدهند که مرد کولهپشتیدار نباید کشته شود.

این معمایی است که دهها سال است مطرح است و هنوز فیلسوفان در باره آن اختلاف نظر دارند. فایده گرایان (Utilitarian) -که عقیده دارند ما برای رسیدن به نهایت خوشبختی یا سعادت باید دست به عمل بزنیم- فکر میکنند حس درونی ما در مورد مرد کولهپشتیدار اشتباه است. آن مرد باید قربانی شود و ما باید جان پنج نفر را نجات دهیم.

معماهایی مثل مسئله قطار بشدت غیر واقعی هستند، با این حال در آینده مواردی خواهند بود که خودروی بدون راننده باید تصمیم بگیرد و انتخاب کند به کدام طرف بپیچد و به چه کسی آسیب بزند یا چه کسی را در معرض خطر قرار دهد.

این پرسشها خود پرسشهای بسیاری در پی میآورند. چه برنامه اخلاقی باید به این خودروهای بدون راننده بدهیم؟ جان سرنشین خودرو را در قیاس با رهگذران و مسافران خودروهای دیگر چگونه باید ارزشگذاری کنیم؟ آیا حاضرید خودرویی بخرید که حاضر است جان سرنشین خود را برای نجات جان رهگذران به خطر بیندازد؟ اگر جوابتان بله است، شما غیرعادی هستید.

و بعد مسئله خطیر دیگری مطرح می شود که این تصمیم هایاخلاقی را چه کسی باید بگیرد. دولت باید تصمیم بگیرد که این خودروها چگونه تولید شوند؟ یا سازندگان خودرو؟ یا شاید خود شما به عنوان مصرف کننده؟ آیا میشود به نمایشگاه خودرو بروید و علاوه بر رنگ ماشین اصول اخلاقی آن را هم انتخاب کنید: "من میخواهم یک پورشه کروکی آبی فایدهگرا که یکی را میکشد تا پنج نفر را نجات دهد بخرم!"

ران ارکین وقتی به این موضوع علاقمند شد که در سال ۲۰۰۴ در کنفرانسی درباره اخلاق روباتی شرکت کرد. او به خاطر میآورد که یکی از حاضران این بحث را پیش کشیده بود که چه گلولهای برای کشتن افراد بهتر است، بزرگ و کند یا کوچک و سریع. این ارکین را به این فکر انداخت که باید انتخاب کند: "آیا باید پا پیش بگذاریم و مسئولیت تکنولوژیای را که خلق می کنیم به عهده بگیریم یا نه." از آن زمان به بعد او خود را وقف اخلاق روبات-اسلحههای خودکار کرده که به روباتهای قاتل معروف شدهاند.

برخی خواستار ممنوعیت روبات-اسلحههای خودکار شدهاند، اما ارکین رویکرد دیگری را در پیش گرفته است: "اگر ما بتوانیم روباتی بسازیم که از مرگ شهروندان جلوگیری کند باید این کار بکنیم."

"من طرفدار جنگ نیستم. اما اگر ما هنوز اینقدر احمقیم که خودمان را بکشیم، به نظر من باید از بیگناهان در میدان نبرد محافظت کنیم."

روبات-اسلحه های خودکار مثل خودروهای بدون راننده موضوع داستان های علمی تخیلی نیستند. سلاحهایی که کنترل آنها کاملا در اختیار انسان نیست همین الان وجود دارند مثل موشکهایی که در صورت مواجه با پدافند تغییر جهت میدهند.

در رویکرد ارکین باید به روباتها برنامهای شبیه به مقررات جنگی کنوانسیون ژنو بدهیم و مثلا مانع از کشتن عمدی غیر نظامیان شویم.

اما همین موضوع پیچیدگی وحشتناکی دارد، روبات باید بین شهروند دشمن که با چاقو می جنگد و جراحی که برای نجات مجروحان چاقو در دست دارد تمایز قائل شود.

راه دیگر بررسی مشکلات این چنینی چیزی است که به آن "یادگیری ماشین" میگویند.

سوزان اندرسون فیلسوف و مایکل اندرسون دانشمند علوم کامپیوتر است. آنها زن و شوهرند و همکار. آنها معتقدند که بهترین راه یاد دادن اخلاق به روباتها این است که ابتدا برخی اصول مشخص را در آنها برنامهریزی کنیم: "پرهیز از درد و رنج، نشر شادی" و بعد به ماشین اجازه بدهیم تا از مواجهه با سناریوهای مختلف یاد بگیرد که چگونه این اصول را در شرایط متفاوت به کار گیرد.

به عنوان مثال روبات-پرستارها را در نظر بگیرید که برای کمک به بیماران و سالمندان طراحی شدهاند، روباتی که برای آنها کتاب یا غذا میآورد، چراغها یا تلویزیون را خاموش میکند. انتظار میرود در دهه آینده صنعت تولید روبات-پرستار شکوفا شود. روبات-پرستارها هم مثل خودروهای بدون راننده و روباتهای قاتل باید گاهی تصمیم بگیرند. فرض کنید بیماری حاضر به خوردن دارویش نباشد، شاید تا چند ساعت این مسئلهای نباشد چون حق بیمار در تصمیم گیری آزاد ارزشی است که ما به آن احترام میگذاریم. اما وقتی هم هست که باید به بیمار کمک کرد چون ممکن است جانش در خطر باشد.

سوزان و مایکل فکر میکنند وقتی روباتها یک سلسله از این مسائل را با استفاده از همان اصول پایه پردازش کنند، برایشان روشنتر میشود که چگونه باید عمل کنند. حتی آدمها هم میتوانند از آنها یاد بگیرند. سوزان میگوید: "من فکر میکنم روباتها از یک فرد معمولی تصمیمهای اخلاقی درستتری خواهند گرفت". نه سوزان نه مایکل از فکر اینکه یک روبات-پرستار از آنها مراقبت کند معذب نیستند. مایکل میگوید اینکه روبات زیر آدم را تمیز کند بمراتب بهتر از شرمندگی این است که یک آدم این کار را بکند.

اما "یادگیری ماشین" هم مشکلات خاص خود را دارد. اول اینکه ماشین ممکن است درس را به اشتباه یاد بگیرد. مثلا معلوم شده ماشینهایی که با تقلید از آدمها زبان یاد، میگیرند پیش داوریهایی را هم یاد میگیرند. اسامی مردها و زنها با چیزهای مختلفی مرتبط هستند و ممکن است ماشین به این باور اشتباه برسد که جک یا فرد برای دانشمند شدن مناسبتر از جوآنا یا فیونا است. ما باید به این سوگیریهای خطا آگاه باشیم و سعی کنیم که با آنها مقابله کنیم.

اما مسئله اساسیتر این است که در سیر یادگیری ممکن است نتوانیم پیشبینی کنیم که روبات در آینده چگونه رفتار میکند، ما ممکن است حتی بدرستی نفهمیم که روبات چگونه تصمیم گرفته است. این احتمال نگران کننده است، بخصوص اگر قرار باشد روباتها تصمیمهای حیاتی زندگی ما را بگیرند. یک راه حل نسبی این است که اگر وضعیت بدی پیش بیاید، بتوانیم این اصول را بازبینی کنیم- در واقع بدقت آنچه را اتفاق افتاده بررسی کنیم. اینکه روبات را مسئول اعمالش بدانیم، هم احمقانه است و هم به درد نمیخورد.- مثلا مجازات کردن روبات چه فایدهای دارد؟ قضاوت بعدی این است که چه کسی اخلاقا و قانونا مسئول اعمال بد یک روبات است.

یکی از مزایای روباتها این است که یکدست عمل میکنند. آنها در شرایط مشابه یک کار را انجام میدهند. روبات-سلاحهای خودکار در اثر عصبانیت تصمیم غلط نمیگیرند. در دنیا سالانه بیش از یک میلیون نفر در تصادف رانندگی میمیرند که علت اکثر آنها خطای انسان است. کاهش این آمار جایزه بزرگی است.

البته این که ما برای یکدستی و یکنواختی ارزش قائل هستیم هم موضوع جالبی است. اگر روباتهای قاضی همیشه از جملات یکسانی برای محکوم کردن مجرمان استفاده کنند، دلیل محکمی است که صدور حکم را به آنها بسپاریم. اما با حذف تماس انسانی قاضی و مجرم، چیزی در این بین از دست نمیرود؟ پروفسور جان تاسیولاس، استاد کینگز کالج لندن، معتقد است که این ارتباطات در هم و برهم انسانی ارزش دارند: "آیا میخواهیم نظام جزایی ما به تضادهای ارزشی دردناکی که در پروندههای قضایی وجود دارد پاسخی مکانیکی و یک دست و یک شکل بدهد.؟ وقتی درستکاری فردی و مسئولیت را از تصمیمگیری انسانی حذف کنیم چیزی واقعا مهم را از دست ندادهایم؟"

ایمی ریمر در باره آینده خودروهای بدون راننده هیجانزده است. فقط این نیست که جان آدمها حفظ میشود، ترافیک و آلودگی کم میشود و یکی از معدود چیزهایی خواهد بود که خرید آن برای شما وقت به همراه می آورد. در مسئله قطار این خودروهای بدون راننده چه خواهند کرد؟ با دو کودک تصادف میکنند یا به طرف دوچرخه میپیچند؟ جگوار لندرور هنوز این پرسش را بررسی نکرده، اما ایمی در اینکه این موضوع اهمیت داشته باشد تردید دارد: "من برای گرفتن گواهینامه رانندگی به چنین سوالی جواب ندادم و الان هم اجازه دارم رانندگی کنم. چرا باید حکم کنیم که خودرو باید برای این سناریوهای نامحتمل جواب داشته باشد پیش از اینکه به خودمان اجازه بدهیم از منافع آن بهرهمند شویم."

حق نشر عکس JAGUAR LAND ROVER

حق نشر عکس JAGUAR LAND ROVER این سوال بسیار خوبی است. اگر خودروهای بدون راننده از کشته شدن انسان ها جلوگیری میکند، چرا نباید آنها را در خیابانها بکار بگیریم و بعد این مسئله را حل کنیم که در مواقع نادر این خودروها چه باید بکنند. البته در نهایت بهتر است امیدوار باشیم که روباتها اخلاقی برنامهریزی شوند- به دلیل اینکه خواه ناخواه در آینده هرچه بیشتر تصمیمهایی را که انسانها میگیرند روباتها خواهند گرفت.

و البته دلایلی برای نگرانی وجود دارد. ممکن است کاملا نفهمیم که چرا روبات یک تصمیم بخصوص را گرفته است. لازم است که مطمئن باشیم روباتها پیشداوریهای ما را دریافت و تشدید نمیکنند. اما یک قابلیت مثبت هم وجود دارد. ممکن است معلوم شود روباتها در برخی تصمیمهای اخلاقی از ما انسانها بهترند. شاید همین ما را انسانهای بهتری کند.